この記事の内容

この記事の要点:

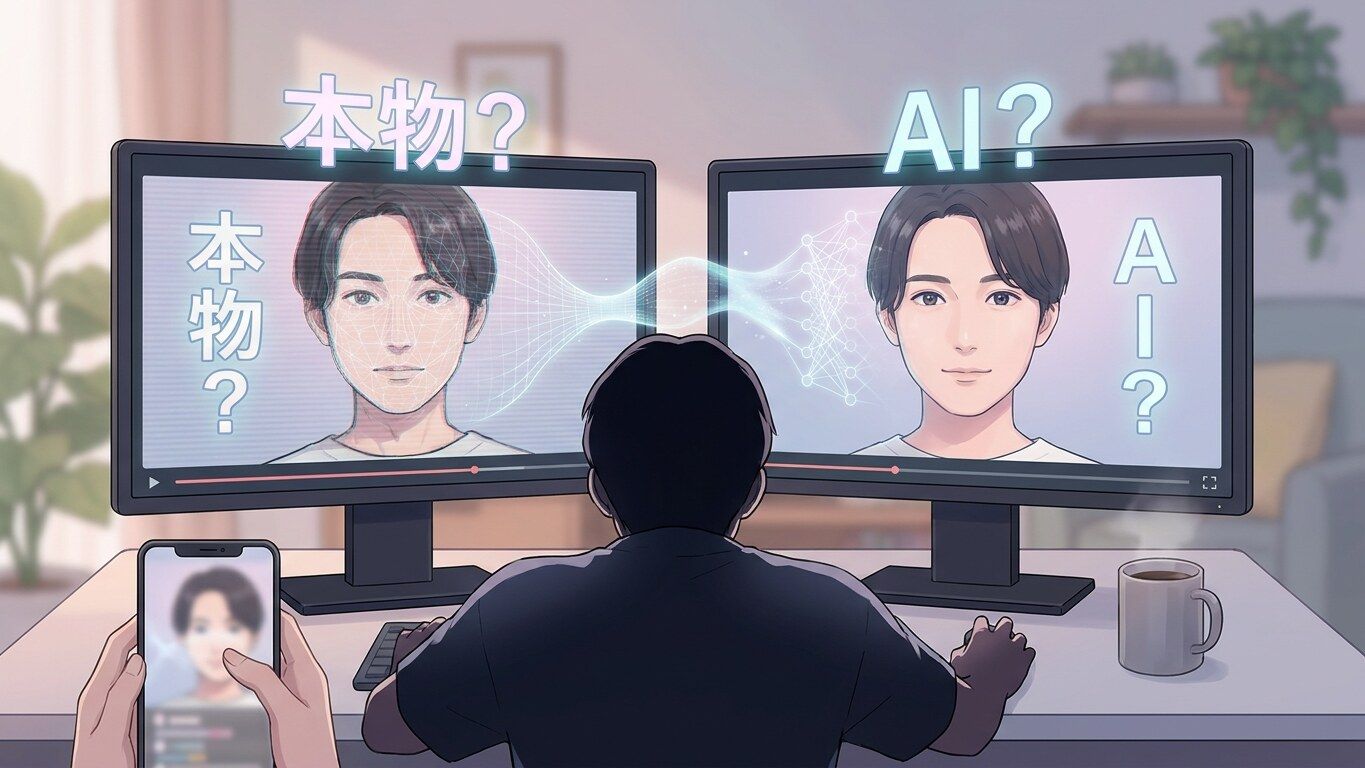

- ディープフェイクとは、AIで人物の顔・声・表情などを合成し、本物らしく見せる技術やコンテンツのことです。

- 便利な一方で、なりすまし、詐欺、名誉毀損、非同意の性的表現、誤情報拡散といった深刻なリスクがあります。

- 見分けるときは、口元やまばたきの不自然さ、音声と唇のズレ、光や影の破綻、出典の不透明さを確認するのが有効です。

- 動画制作では、Filmoraの画像から動画生成、顔ぼかし、顔出しなし編集などを使い、本人保護と表現の安全性を両立しやすくなります。

ディープフェイクとは?意味と仕組み

ディープフェイクとは、AIを使って人の顔、声、表情、動きなどを合成し、あたかも本人が話したり行動したりしているように見せる技術、またはその技術で作られた画像・動画・音声のことです。とくにSNSや動画共有サービスでは、短時間で強い印象を与えるため、本物と誤認されやすいケースが問題になっています。

もともとは研究や映像制作の文脈でも使われてきた技術ですが、近年は一般ユーザーでも扱いやすい生成AIツールが増えたことで、エンタメ、広告、パロディ、教育だけでなく、なりすましや詐欺のような悪用リスクまで一気に広がりました。

ディープフェイクとは、AIによって“本物のように見える偽の映像や音声”を作る技術です。

重要なのは、技術そのものよりもどの目的で使われるかです。映像表現や教育に役立つ一方で、本人の同意がない合成、誤情報拡散、性的被害、詐欺に使われると深刻な問題になります。

ディープフェイクの語源と仕組み

「ディープフェイク」は、深層学習を意味する deep learning と、偽物を意味する fake を組み合わせた言葉です。大量の画像や動画、音声サンプルを学習したAIが、顔の向き、表情、口の動き、声色などを分析し、別の人物の映像に重ね合わせることで自然に見える合成結果を作ります。

| 項目 | 内容 | 具体例 |

| 顔の合成 | 別人の顔を動画上の人物に重ねる | 有名人の顔を別の映像に置き換える |

| 音声の合成 | 声の特徴を学習して別の発言を作る | 本人が言っていない台詞を読ませる |

| 動きの再現 | 表情や口の動きをなめらかに合わせる | 話しているように見える偽動画を作る |

ディープフェイクとフェイススワップの違い

似た言葉にフェイススワップがありますが、すべてが同じ意味ではありません。フェイススワップは顔の入れ替え機能そのものを指すことが多く、ディープフェイクはそこにAIによる高度な自然さや誤認性が加わった広い概念として使われます。

| 比較項目 | ディープフェイク | フェイススワップ |

| 目的 | 本物らしい合成結果を作る | 顔を入れ替えて遊ぶ・演出する |

| 自然さ | 高精度で見分けにくい場合がある | 比較的わかりやすい加工も多い |

| リスク | 詐欺、なりすまし、誤情報拡散に発展しやすい | 用途次第だが比較的軽い演出にも使われる |

なぜディープフェイクが問題になるのか

ディープフェイクが問題視される理由は、単なる“面白加工”の域を超えて、本人確認、信頼、社会的評価、情報の真偽そのものを揺るがすからです。視覚と音声の両方がリアルに見えると、見る側は短時間で本物だと信じやすくなります。

被害が広がりやすい理由

ディープフェイクは、制作の難易度が下がったこと、SNSで拡散速度が速いこと、見る側が短い動画を即判断しがちなことから、被害が大きくなりやすい傾向があります。

| 要因 | なぜ危険か |

| 生成AIの普及 | 専門知識が少なくても、それらしい映像や音声を作りやすくなったため。 |

| SNS拡散の速さ | 誤情報が訂正より先に広まりやすく、切り抜きだけで信じられることがあるため。 |

| 短尺動画文化 | 視聴者が細部を検証する前に“本物っぽさ”で判断しやすいため。 |

| 保存・再投稿の容易さ | 一度出回ると完全削除が難しく、被害が長引きやすいため。 |

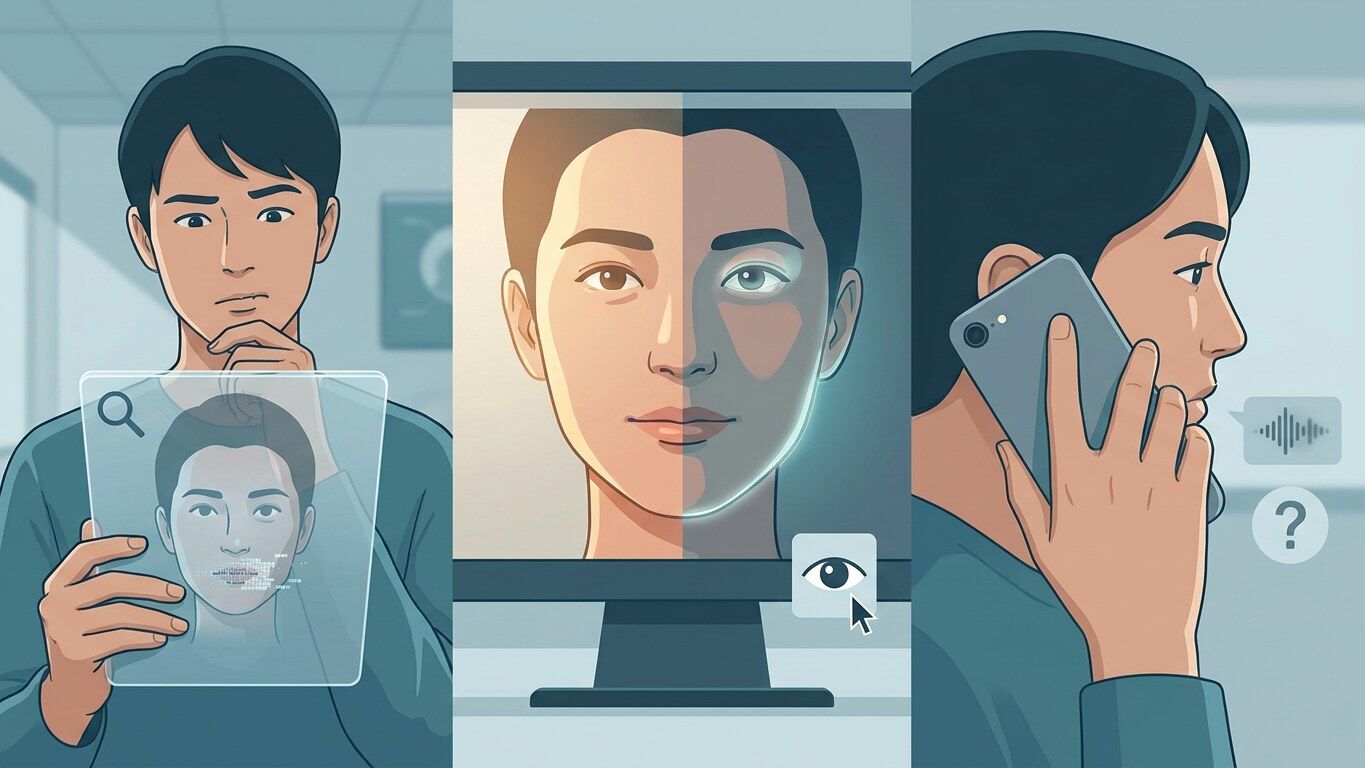

ディープフェイクの見分け方

最近のディープフェイクは非常に自然に見えるものもありますが、細かく見ると違和感が残ることがあります。重要なのは、ひとつのポイントだけで断定せず、複数の違和感を合わせて判断することです。

答え: ディープフェイクを見分けるときは、顔全体の自然さだけでなく、口元・まばたき・音声・光・出典の5点を確認するのが基本です。

- 口の動きと音声がずれていないか

- まばたきや表情変化が不自然でないか

- 顔の輪郭、髪の境界、耳まわりに破綻がないか

- 光の向きや影、肌の質感が一貫しているか

- 元の投稿者や出典が信頼できるか

一般ユーザーが取れる対策

見分けるだけでなく、拡散しないことも重要です。とくにセンセーショナルな内容ほど、確認前に保存・転載・引用しない姿勢が被害抑止につながります。

- 不自然だと感じたら、すぐに再投稿しない

- 投稿者の過去発信や公式アカウントを確認する

- 画像検索やニュース検索で元ネタを追う

- 人物保護が必要な場合は、顔ぼかしや切り抜きで再編集して扱う

日本で意識したい法律・倫理・安全性

ディープフェイクに関する論点は、ひとつの法律だけでは整理できません。日本で考える場合も、名誉毀損、プライバシー、肖像権、著作権、詐欺、未成年保護、プラットフォーム規約など、複数の観点を合わせて見る必要があります。

| 論点 | 注意したいポイント |

| 名誉毀損・信用毀損 | 本人がしていない発言や行動を偽装して拡散すると、社会的評価を下げるおそれがあります。 |

| プライバシー・肖像権 | 実在人物の顔や声を本人同意なく利用すると、私的領域や人格的利益の侵害につながる可能性があります。 |

| 著作権 | 元映像、写真、音声の無断利用や改変が権利侵害になる場合があります。 |

| 詐欺・なりすまし | 経営者や家族を装った偽音声・偽動画で送金や契約を誘導する手口に発展することがあります。 |

| 未成年保護・性的被害 | 未成年や非同意の性的合成は特に重大で、社会的にも法的にも厳しく問題視されます。 |

“面白い加工”では済まないケースがある

友人同士の軽いネタとして始まった加工でも、公開範囲が広がると状況は変わります。本人が不快に感じる、第三者が本物だと誤信する、業務や学校に影響する、といった実害が出れば、冗談では済まなくなります。

ディープフェイクを安全に考えるうえでの基準は、本人の同意があるか、第三者を誤解させないか、公開先の規約に適合しているかの3点です。

ディープフェイク時代にできる安全な動画表現

AI時代の動画制作では、“リアルに偽装する”方向ではなく、“安全に伝える”方向で技術を使うことが大切です。たとえば、実在人物を誤認させる合成ではなく、イラスト、抽象表現、テンプレート、ぼかし編集、顔出しなし構成に寄せることで、伝えたい内容を保ちながらリスクを下げやすくなります。

その点で、Filmora には、危うい合成を避けながら見せ方を工夫しやすい機能があります。たとえば、画像から動画生成 を使えば、コンセプト画像やイラストをベースに非写実的な動画表現を作りやすく、実在人物の誤認を避けた演出に向いています。また、人物保護が必要な場面では、モザイク・ぼかし編集 や、顔出しなし動画の作り方 も参考になります。

関連記事

ディープフェイクとは、AIで本物らしい偽の映像や音声を作る技術です。便利な技術である一方、なりすまし、詐欺、誤情報、非同意の性的被害など、現実の被害につながる危険もあります。

だからこそ、意味を知るだけでなく、見分け方、安全性、法律、そして代替表現までセットで理解することが重要です。動画制作では、リアルな偽装へ寄せるのではなく、画像から動画生成、顔ぼかし、顔出しなし編集のような安全な表現方法を選ぶと、伝えたい内容とリスク管理を両立しやすくなります。